(사진=유튜브) |

대형언어모델(LLM)의 사전 학습(pre-training) 데이터가 지나치게 많을 경우, 모델의 미세조정이 어려워지고 성능이 저하될 수 있다는 연구 결과가 발표됐다. 이는 일부 개발자들이 모델 학습 과정에서 테스트해왔던 것으로, 논문을 통해 발표된 것은 드문 일이다.

카네기멜론대학교, 스탠포드대학교, 하버드대학교, 프린스턴대학교 연구진은 28일(현지시간) LLM의 사전 학습 데이터 규모 확장이 사후 학습(post-training) 후 성능 저하로 이어질 수 있다는 '과잉 훈련 재앙(Catastrophic Overtraining)' 개념에 관한 논문을 온라인 아카이브에 게재했다.

일반적으로 LLM은 방대한 데이터로 사전 학습을 진행한 후, 특정 작업에 맞춰 고품질 데이터를 이용해 사후 학습을 수행하는 방식으로 구축된다. 지금까지는 "데이터가 많을수록 성능이 좋아진다"는 원칙에 따라 사전 학습과 사후 학습의 규모가 지속적으로 확대됐다. 이는 '스케일링 법칙(Scaling Laws)'으로 알려져 있으며, LLM에 더 많은 데이터와 컴퓨팅 자원을 투입하면 성능이 향상된다는 개념이다.

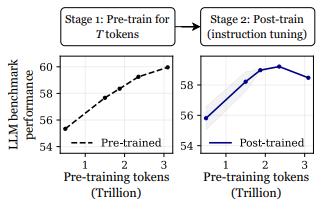

그 결과, 3조 토큰 모델은 '지시 튜닝(instruction tuning)' 후 여러 LLM 벤치마크에서 2% 이상 낮은 성능을 보였으며, 일부 평가에서는 성능 저하가 3%에 달했다.

연구진은 이런 성능 저하가 모델이 확장된 사전 학습을 거치면서 매개변수가 변화에 더욱 민감해지는 현상으로 설명했다. 즉, 모델이 지시 튜닝, 멀티모달 작업을 위한 미세조정, 단순한 가중치 변동과 같은 수정 과정에서 성능이 더 쉽게 저하될 가능성이 커진다는 것이다. 이런 민감도의 증가는 LLM이 새로운 데이터를 학습할 때 기존에 습득한 능력을 잃어버리는 '망각(forgetting)' 현상으로 이어진다고 밝혔다.

또 연구진은 사전 학습이 일정 임계점을 넘어설 경우, 어떤 방식으로 모델을 수정하더라도 기존에 배운 능력이 더 많이 손실될 수 있다는 점을 발견했다. 추가적인 사전 학습이 미세조정의 효과를 감소시키거나 심지어 부정적인 영향을 미칠 수 있다는 설명이다. 올모-1B 모델의 경우, 약 2.5조 토큰이 임계점이 나타났다.

연구진은 이러한 성능 저하 현상이 우연한 결과가 아니라, 일관되게 나타나는 '과잉 훈련 재앙(catastrophic overtraining)'의 사례라고 강조했다. 이는 최근 LLM의 성능 향상이 기대만큼 이루어지지 않으면서, 기존의 스케일링 법칙이 한계에 다다랐다는 지적과 맞물린다.

이에 따라 연구진은 사전 학습의 규모를 무작정 확장하는 것이 아니라, 모델의 적응성과 안정성을 고려한 새로운 학습 전략이 필요하다고 주장했다. 실제로 최근에는 강화 학습(RL)과 추론 최적화(reasoning optimization) 등 사전 학습을 보완하는 다양한 접근 방식이 주목받고 있다.

또 과잉훈련 재앙이 언제 어떻게 발생하는지에 영향을 미치는 요인을 이해하기 위해 추가 연구가 필요하다는 것을 인정했다. 미해결 문제로는 사전 훈련 최적화 프로그램, 훈련 목표, 데이터 분포 등이 어떤 영향을 미치는 지에 대한 여부가 포함된다.

박찬 기자 cpark@aitimes.com

<저작권자 copyright ⓒ ai타임스 무단전재 및 재배포 금지>